Катастрофа в 2032 году почти отменяется. Новые наблюдения за астероидом 2024 YR4 с помощью европейского телескопа VLT и других обсерваторий практически полностью исключили возможность столкновения этого астероида с нашей планетой.

Еще неделю назад астрономы оценивали вероятность столкновения космического объекта с Землей в 3%. Однако дополнительные исследования понизили риск катастрофы до тысячных долей процента.

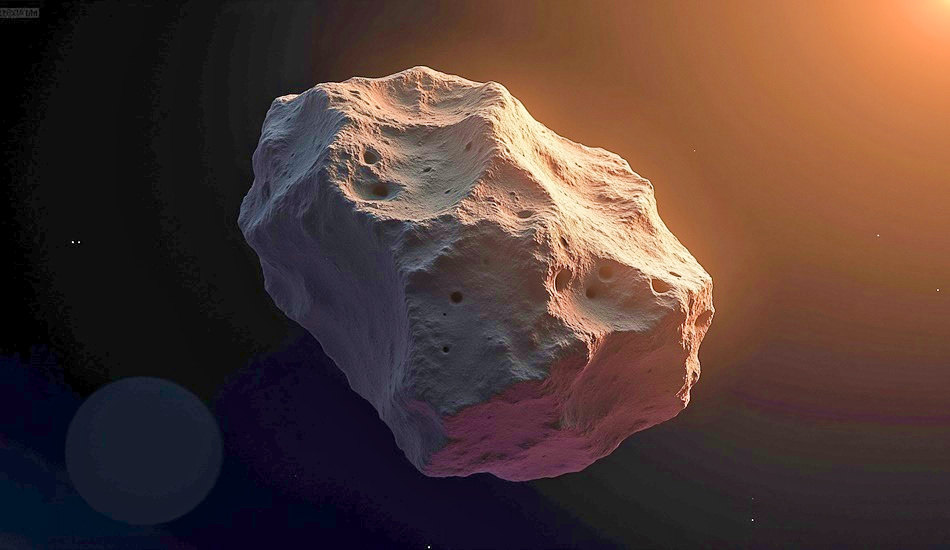

Астероид 2024 YR4 диаметром от 40 до 90 метров, был обнаружен в конце декабря прошлого года на орбите, которая может привести к столкновению с Землей 22 декабря 2032 года. Из-за своих размеров и вероятности столкновения астероид быстро занял первое место в списке серьезных рисков в каталоге Европейского космического агентства (ЕКА).

Наблюдения за 2024 YR4 в середине января велись с помощью телескопа VLT ESO, что позволило астрономам получить важнейшие данные, необходимые для более точного расчета его орбиты. В сочетании с данными, полученными от других обсерваторий, учеными был вынесен вердикт о крайне малой опасности столкновения.

На данный момент вероятность столкновения, по данным Координационного центра ЕКА по объектам, сближающимся с Землей, составляет около 0,001 %, и астероид больше не входит в список рисков ЕКА.