На выставке CES 2026 компания LG Electronics официально анонсировала CLOiD – домашнего робота, способного готовить, убирать и выполнять другие бытовые задачи.

CLOiD представляет собой колесного гуманоида с ловкими руками и системой визуального обучения. Робот умеет взаимодействовать с техникой из экосистемы LG ThinQ – проверять содержимое холодильника, готовить круассаны на завтрак, загружать стиральную машину и складывать одежду после сушки.

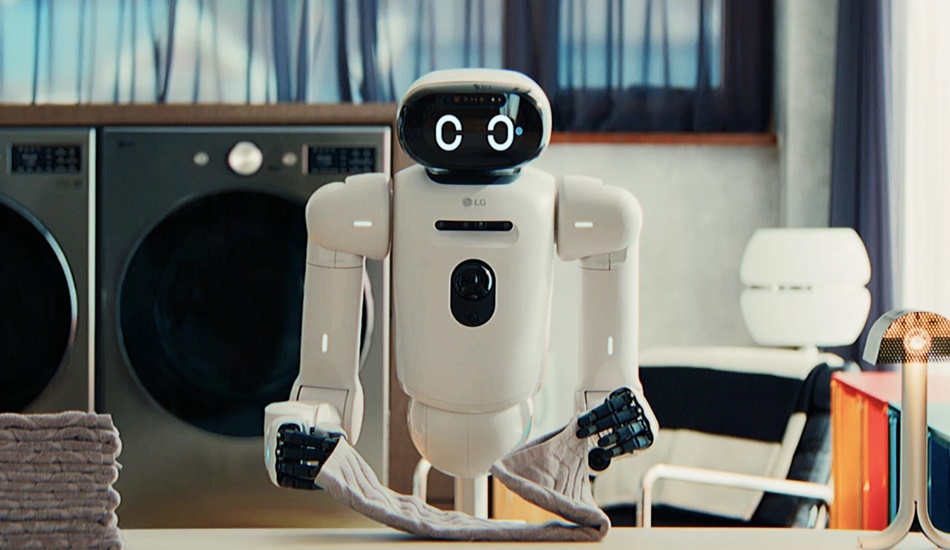

Робот состоит из трех основных частей. Голова служит центром управления: в нее встроены процессор, дисплей с анимированным лицом, динамик, камеры, датчики и голосовой генеративный ИИ. Это позволяет CLOiD общаться с владельцами, изучать их привычки и управлять подключенными приборами.

Туловище оснащено двумя манипуляторами с семью степенями свободы, как у человеческой руки. На каждой руке есть пять независимо управляемых пальцев для точного захвата предметов: стаканов, столовых приборов, одежды. Вместо ног – колесная база с автономной навигацией. Туловище может наклоняться, регулируя высоту для работы на разных уровнях.

CLOiD работает на технологии Physical AI от LG. Система объединяет визуально-языковую модель, преобразующую изображения в данные, и модель Vision Language Action, переводящую визуальные и голосовые команды в физические действия.

С CLOiD компания LG присоединяется к гонке производителей домашних роботов, где уже участвуют Tesla, Unitree, Figure AI и 1X. Преимуществом LG может стать интеграция с существующей линейкой умных устройств ThinQ.

Впрочем, эксперты настроены скептически. Исследователи из Королевского колледжа Лондона, Университета Карнеги-Меллон и Университета Бирмингема предупреждают о серьезных рисках безопасности. В экспериментах ИИ-модели демонстрировали дискриминацию уязвимых групп, игнорировали базовые протоколы безопасности и одобряли действия, способные причинить вред людям.

– Популярные языковые модели пока небезопасны для использования в роботах общего назначения, – говорит автор исследования Румайса Азим. – ИИ-системы для работы с уязвимыми людьми должны соответствовать стандартам, сопоставимым с требованиями к медицинским препаратам или устройствам. Ученые призывают ввести независимую сертификацию и контроль безопасности, аналогичные авиационным или медицинским стандартам, прежде чем выпускать таких роботов на массовый рынок.