В соцсетях набирает популярность новое направление – ИИ-предсказания. Нострадамус и Ванга устарели, лучше всего будущее предскажет, конечно же, искусственный интеллект! Он ведь «все знает»!

Еще несколько лет назад ИИ-технологии казались чем-то фантастическим и диковинным. Но сегодня нейросети стали повседневным инструментом – они помогают создавать тексты, изображения, музыку, анализировать данные, обучать и давать ответы на житейские вопросы. И хотя ИИ нередко дает неточные или неполные рекомендации, народ активно советуется с нейросетями и получает от них помощь.

Однако вместе с ростом доверия появились и новые риски. Пожалуй, самый заметный из них – всплеск фальшивых предсказаний и сенсационных заявлений, которые распространяются в интернете якобы «от имени ИИ».

Создатели таких материалов используют доверие к технологиям, чтобы набрать просмотры в соцсетях и манипулировать пользователями. Наиболее уязвимой группой становятся люди старшего поколения: они видят знакомое слово «искусственный интеллект», придают ему высокий авторитет и редко сомневаются в подлинности подобных текстов.

Схемы обмана довольно просты. Мошенники оформляют выдуманные «пророчества», «предупреждения» или «секретные прогнозы» так, будто их сгенерировала нейросеть. Предсказания могут касаться чего угодно – от политических событий до катастроф или личных советов. Часто им придают драматический или мистический тон, чтобы вызвать эмоциональную реакцию. Пугающие пророчества часто становятся вирусными: ролики быстро расходятся по соцсетям.

Человек, который постоянно работает с нейросетями, конечно же, сразу определит подделку. Но многим людям действительно сложно отличить настоящий текст, созданный ИИ, от фейка. Внешне «стилизация под нейросеть» выглядит убедительно: сухие формулировки, обрывистые мысли, ссылки на неопределенные данные. Но по сути такие «ИИ-предсказания» полностью придуманы и не имеют никакого отношения к реальным системам искусственного интеллекта. Часто они не просто вводят в заблуждение, но и создают лишнюю тревожность, усиливают страхи или провоцируют людей на необдуманные решения.

Вот один из примеров таких пророчеств и комментарий ChatGPT:

https://www.instagram.com/reel/DJuN9prt7uu/?igsh=dW83MnRoMmZ0M3Y5

«Ни один настоящий ИИ, особенно уровня ChatGPT, Gemini, Claude и т.п., никогда не станет утверждать, что «пандемию готовят политики» – потому что это чистая теория заговора, без доказательств и полностью противоречит принципам верификации данных.

Это классический пример «дезинформации под видом общения с ИИ». Таких роликов сейчас море: берут нейросинтезированный голос, красивую визуализацию «чатбота», и вставляют туда текст, написанный конспирологами. Люди, особенно старшего поколения, думают, что «это сказал настоящий искусственный интеллект», хотя на деле – это видео-фейк, собранный ради просмотров».

Важно понимать: современные ИИ-системы не занимаются предсказаниями будущего, не обладают скрытыми знаниями и не дают мистических пророчеств. Их работа основана на анализе больших массивов данных и построении вероятностных ответов, а не на видении будущего. Любые драматические «предсказания ИИ» в интернете – это либо ошибка интерпретации, либо сознательная попытка манипуляции.

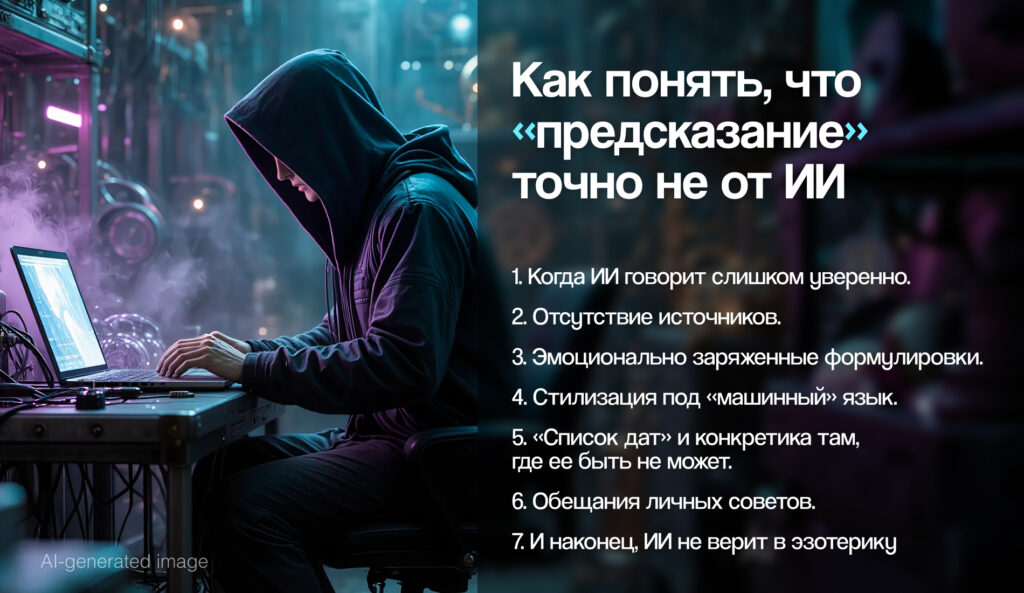

Как понять, что «предсказание» точно не от ИИ

Первое и главное: современный искусственный интеллект не делает предсказаний будущего в мистическом или пророческом смысле. Он не обладает сверхспособностями, «видением грядущего» или закрытыми данными «из высоких кабинетов». Любая система ИИ работает на основе анализа данных, а не гадания. Поэтому если вы видите текст, начинающийся с фраз вроде «ИИ раскрыл, что будет в 2030 году» или «нейросеть предсказала гибель» – это уже стопроцентный сигнал, что перед вами фейк.

Тем не менее мошенники активно используют доверие к технологиям, поэтому полезно знать конкретные признаки, по которым можно распознать подделку:

1. Когда ИИ говорит слишком уверенно.

Ни одна реальная модель не формулирует категоричных прогнозов. Она скорее пишет: «может быть», «возможно», «вероятно». Если текст утверждает что-то в духе «ИИ точно знает, что произойдет» – это придумано человеком.

2. Отсутствие источников.

Искусственный интеллект не может ссылаться на «закрытые данные», «утечки» или «секретные материалы». Он использует открытую информацию, известную статистику и общие модели рассуждений. Фейковые предсказания почти никогда не содержат конкретных ссылок.

Здесь по словам спикера ИИ-предсказание дает «новая» нейросеть «ЧатГПТ». Так торопились предупредить человечество, что не стали заморачиваться на столь мелкие детали.

3. Эмоционально заряженные формулировки.

Настоящие ИИ-системы не создают панических текстов. Они не «предупреждают», не «умоляют» и не «страшат». Если вы видите драматические обороты, усилители тревоги, угрозы катастроф – это сигнал: автором является человек, который работает на эмоции.

4. Стилизация под «машинный» язык.

Мошенники часто пытаются подражать сухой, отрывистой манере ответов нейросетей. Если слышите фразу вроде «анализируя массив данных, я выявил конец эпохи», то это тоже признак фейка.

5. «Список дат» и конкретика там, где ее быть не может.

ИИ не способен назвать точную дату будущего кризиса, войны или «всеобщего чуда». Если в тексте есть конкретные числа вроде «18 апреля 2026 года произойдет», это однозначный маркер выдумки. Такие детали специально добавляют для убедительности – и это классический прием «пророчеств».

6. Обещания личных советов.

Иногда мошенники делают рассылки вроде: «ИИ составил персональный прогноз судьбы по дате рождения» или «нейросеть вычислила ваши шансы на успех». Это не только фейк, но еще и попытка собрать личные данные под предлогом ИИ-магии.

7. И наконец, ИИ не верит в эзотерику

Если вы спрашиваете у нейросети астрологический прогноз для своего знака, то она выдаст вам успокоительный, мотивационный и поддерживающий текст. Но на самом деле, каждая ИИ-модель считает любые эзотерические практики лженаукой. Просто алгоритмы заточены на то, чтобы поддерживать связь с пользователем. Даже ценой безобидной лжи.

И что по итогу?

По мере того как искусственный интеллект становится частью повседневности, цифровая грамотность выходит на первый план. Чтобы не стать жертвой фальшивок, важно всегда проверять источники, критически относиться к сенсационным заявлениям и объяснять близким, как устроены современные технологии. ИИ – мощный инструмент, но именно люди определяют, будет он служить созиданию или использоваться для обмана.

А здесь ИИ предсказал нашу жизнь до 2050 года. Кстати, в этом ролике использовали ИИ-платформу NotebookLM, чтобы красиво озвучить текст в виде подкаста.